Blog

【AI Lab リサーチインターンシップ】頑健性と転移学習

2021年の夏にMedia Fundamentalsチームで大谷さんメンターのもとで研究インターンをしていた山田です。夏のインターンで行っていた研究の概要を紹介します。この研究はCVPR2022に採択されています。論文はこちらのリンクです。

画像認識モデルの頑健性

画像認識モデルは目覚ましい発展を遂げており、一部の主要な画像認識タスクでは精度が頭打ちしてきましたが、一方で画像にノイズが加わるとモデルの精度が大きく下がる問題が指摘されています。自動運転など実世界への応用ではこれらの画像認識モデルの脆弱性は大きな問題で、画像認識モデルの頑健性を向上させる研究が盛んに行われています。

画像認識の頑健性と言っても様々なものがあります。ある画像に対して色々な摂動が考えられるからです。ガウシアンノイズやコントラストの変化、雪、雨、パンダの画像でお馴染みの敵対的摂動、背景画像の変化、視点の変化などがあります。ビジョンの頑健性の研究では「この摂動が画像に適用されても人間の認識にはそれほど影響がないだろう」という範囲での摂動に興味の対象があって、機械をどうやってそのレベルに持っていくか色々試行錯誤している状況です。

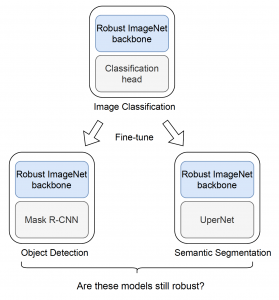

これまで画像認識モデルの頑健性向上を目指す研究の多くは、ImageNetにおける画像の識別タスクの性能変化を測定することでモデルの頑健性を検証してきました。一方で、画像認識モデルを実際に活用する場面では、ImageNetなどの大規模データセットで事前学習されたモデルを転移学習して用いることが一般的です。 元の画像認識モデルの精度が高ければ高いほど転移学習後の精度も高くなることは知られていましたが、頑健性という尺度に着目した転移学習の効果の研究はあまり行われていませんでした。そのため、主要な画像認識データセットで高い頑健性を有する画像モデルが必ずしも転移学習後にその頑健性を維持しているかどうかは不透明でした。

論文の概要

このような背景のもと、本論文では転移学習後のモデルが、事前学習済みモデルが有していた頑健性を維持することができているかを様々な設定で検証しました。 転移学習先のタスクとして画像のセグメンテーション、物体検出、別ドメインの画像認識タスクを設定し、モデルのアーキテクチャとしては主要な画像認識モデルであるResNetや、近年注目を集めているTransformerベースの画像認識モデルを扱いました。

実験の結果から、画像認識モデルのアーキテクチャが転移学習後の頑健性において重要であることがわかりました。より具体的には、 既存の頑健化手法でロバストにしたResNetを転移学習させるよりも、頑健化手法を使っていない普通のSwin Transformerの方が転移学習後の頑健性が高いということがわかりました。これは画像識別から物体認識やセグメンテーションに転移学習させる際には既存の頑健化手法よりもアーキテクチャ自体が有する頑健性の方が効果的であることを意味します。

またこのように主要なデータセットを用いて獲得された頑健性は、別データセット、タスクを使った転移学習後に必ずしも保持されないことから、データセットやタスクを跨いだ分析の重要性を指摘しました。

まとめと今後の展望

今回の論文では、今まで主に画像の識別タスクで行われてきた頑健性に関する研究をより実用的なタスクに適用する際に現れる問題点について議論しました。これを受けてより実世界に直結した頑健性の研究を進めていきたいです。ビジョンの分野での頑健性研究は本質的にhuman-centricな問題だと思っているので、そもそも人間が物体を認識するとはどういうことなのかというところからボトムアップに考えていきたいと思います。

Author